问题咨询与支持

- ⭐️ 请先 Star 项目后再提问(未 Star 的问题将直接关闭)

- 🐞 提交 GitHub Issue 时请包含:

- 问题截图

- SDK 版本信息

- 相关配置代码

模型概述

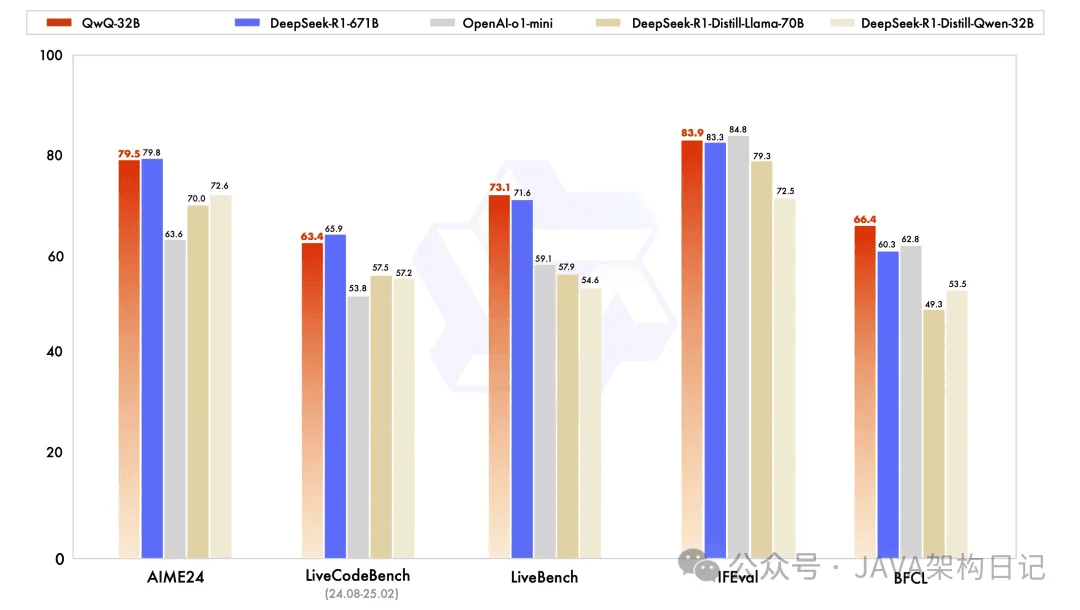

QwQ-32B 是阿里巴巴 Qwen 团队基于 Qwen2.5 架构研发的高性能大语言模型,专为企业级推理任务设计。该模型在保持高质量输出的同时,显著提升了推理速度和资源利用效率。核心优势

- 高性能推理:针对生产环境优化,显著降低延迟

- 强大的理解能力:继承 Qwen2.5 架构的优秀语义理解能力

- 多场景适配:适用于对话、内容生成、代码辅助等多种应用场景

硅基流动平台配置

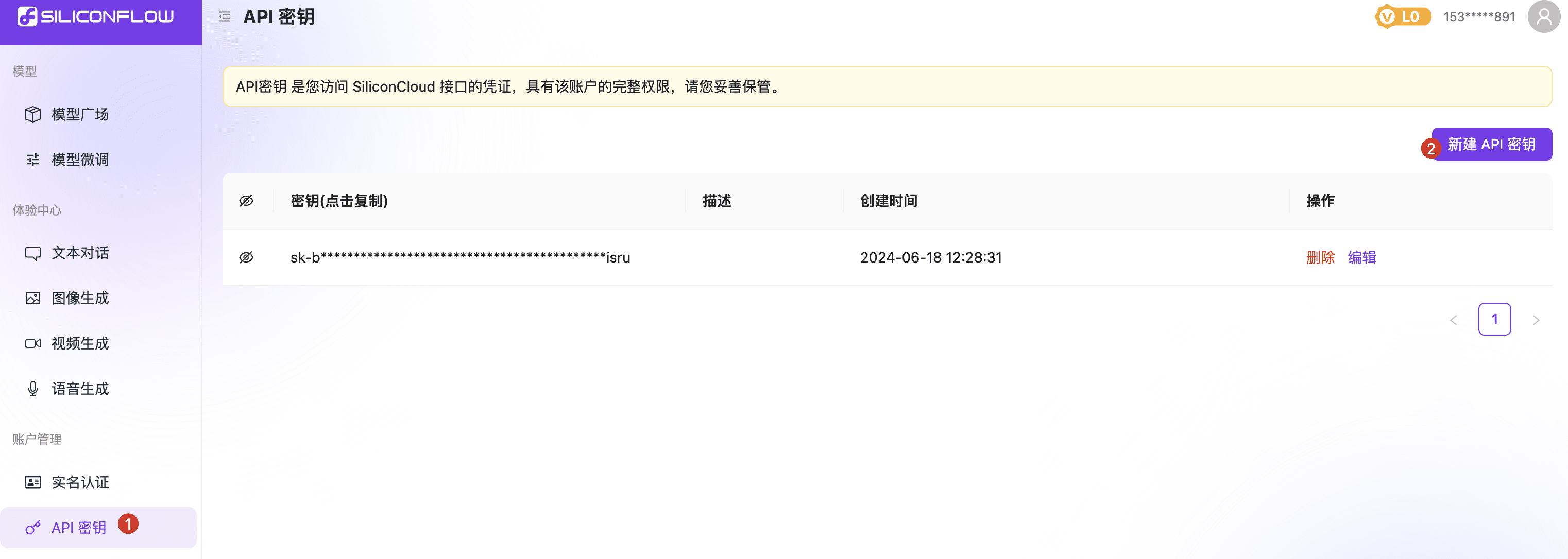

1. 获取访问凭证

- 访问硅基流动控制台:https://cloud.siliconflow.cn/account/ak

- 登录账户并创建新的 API 密钥

- 妥善保存生成的密钥,后续将无法再次查看

deepseek4j SDK 集成

1. 配置文件设置

在应用的application.yml 或 application.properties 中添加以下配置:

2. 代码实现示例

基础对话接口

高级参数配置

应用场景与最佳实践

- 智能客服:利用模型出色的对话能力构建自然流畅的客户服务系统

- 内容生成:自动化内容创作,辅助营销文案、产品描述等撰写

- 代码辅助:提供代码补全、调试和优化建议,提升开发效率

PIG AI应用开发平台 | 企业级AI中台解决方案

为Java开发者提供全栈式AI工程化解决方案,强类型/高可维护性架构,内置30+主流大模型支持。

- 🔍 知识引擎体系:RAG 知识引擎全自动化多模态解决方案

- 📝 AI-OCR 中枢:复杂非标场景高精度识别

- ⚙️ 业务智能融合:函数编排 + Chat2SQL,无缝对接现有业务系统

- 🛡️ N维风控体系:敏感词/IP/Token/User 规则控制引擎

文档改进

发现文档问题?点击此处直接在 GitHub 上编辑并提交 PR,帮助我们持续改进!

文档有误?请协助编辑

发现文档问题?点击此处直接在 GitHub 上编辑并提交 PR,帮助我们改进文档!